Moja książka o ryzyku: w opiece zdrowotnej

Moja książka o ryzyku: w opiece zdrowotnej

Trzecia moja książka, a druga recenzowana monografia trafiła na półki księgarskie (link w tekście poniżej). “ Ryzyko nowych technologii informacyjnych w opiece zdrowotnej” to, o ile mi wiadomo, pierwsza w Polsce próba całościowej analizy ryzyk związanych z wdrażaniem zaawansowanych algorytmów, sztucznej inteligencji, wielkich modeli językowych LLM, Internetu Rzeczy (IoT), procesowania języka naturalnego (NLP), widzenia komputerowego (CV), mediów społecznościowych, robotów medycznych, Medycyny 4.0/5.0 i nie tylko.

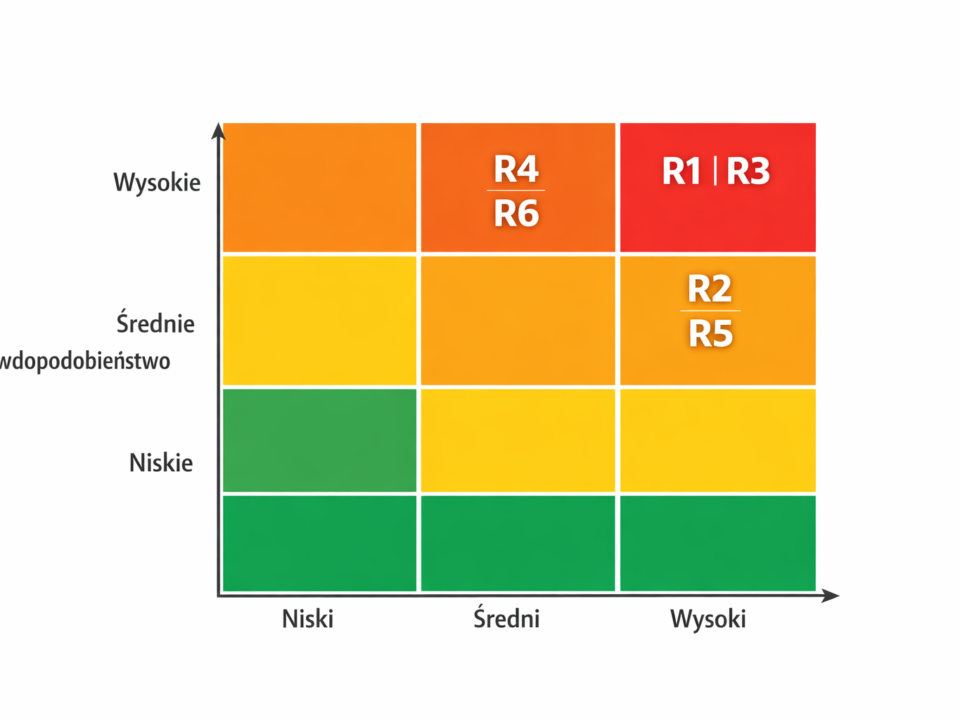

Książka zawiera opis ponad 60 zidentyfikowanych ryzyk, ich analizę przyczynowo-skutkową, mapy ryzyka ryzyk. Wszystko zgodnie z normą ISO 31000 Zarządzanie ryzykiem, którą wybrałem jako “przewodnik” metodyczny do tej analizy, co moim zdaniem stanowi (nie tylko w tym punkcie) praktyczną, nie tylko naukową wartość dodaną tego opracowania.

Na zakończenie monografii w załączniku – aneksie, czytelnik znajdzie wyniki symulacji Monte Carlo, która pozwala ocenić stabilność-niestabilność dokonanej analizy ryzyk (dodajmy przy okazji, że MC, to klasyczna technika oceny ryzyka, zgodnie z 31010 Risk management — Risk assessment techniques.

Książka zawiera bardzo bogatą literaturę zagraniczną i polską, ponad 300 pozycji.

Moim zdaniem, analiza ryzyk związanych z wdrażaniem zaawansowanych algorytmów w szeroko rozumianej opiece zdrowotnej (szpitale, przechodnie, podstawowa opieka zdrowotna, opieka senioralna, usługi stomatologiczne, sanatoria etc etc) jest bardzo ważna z wielu przyczyn, w tym choćby z takiej, że protagoniści technologii algorytmicznych w każdej chyba dyskusji, jako najważniejszy argument “ZA” wskazują korzyści płynące z medycznego obszaru wdrożenia tej technologii.

I, o ile jest to argument mocny i zapewne słuszny nie należy zapominać, że każda nowa technologia, a taka przełomowa jak algorytmy z pewnością, oprócz szans tworzy także nowe zagrożenia. Banalna jest więc przy tym konstatacja, choć zadziwiające jak często niedostrzegana, że dla pełnego “rachunku wyników” jest potrzebna ocena obydwu stron tego wdrożeniowego równania.

Często zagrożenia wdrażania AI w opiece zdrowotnej nie są na pierwszy rzut oka widoczne, albo nawet nie odnotowano (jeszcze) przypadków ich (masowej) manifestacji, jak choćby ataki adwersarskie (adversarial attacks), polegające między innymi na manipulacją algorytmem (np. sterującym robotem medycznym, czy całym modelem językowym) tak by dział on w sposób niezgodny z przeznaczeniem. To tylko jeden z tych przykładów ryzyka, który jak się zdaje, nie jest w ogóle brany pod uwagę w przypadku wdrażania technologii algorytmicznych w opiece zdrowotnej, a jest już jak najbardziej technologicznie wykonalny.

Zapraszam do darmowej Subskrybcji mojego Substacka Ryzykonomia! Link:

https://jerzypodlewski.substack.com

Nie ma wątpliwości natomiast, że ryzyka opisywane w książce będą się coraz częściej manifestować i ujawniać, tak jak na przykład już “buszujący w zbożu” algoritmic bias, ładnie tłumaczony na polski jako “stronniczość” automatyzacji. Algorytmy są bowiem, (póki co, a i to się szybko zmienia) tworzone u swych podstaw przede wszystkim przez ludzi, korzystają z tworzonych przez nich zasobów danych i mają z tej przyczyny zaklęte w sobie ludzkie przyzwyczajenia, preferencje, niechęci, przesądy.

A że nie są to fantazje i także w Polsce wystarczy wspomnieć, że na przykład ZUS i Państwowa Inspekcja Pracy wdraża od 2025 roku algorytm analizujący (jak czytamy w informacjach prasowych) nieobecności w pracy itd. Związek z opieka zdrowotną, chorobami, zwolnieniami jest tu oczywisty i pokazuje, że problem algorytmów w medycynie promieniuje na bardzo szeroki obszary życia społecznego i gospodarczego.

…albo weźmy Medyczny Internet Rzeczy (MIoT), który w diagnostyce zdrowotnej przynosi gigantyczne możliwości, nie tylko w zakresie sensu stricto urządzeń medycznych, ale na przykład sterowania całą infrastrukturą techniczną tzw. inteligentnego szpitala. Już chyba każde urządzenie medyczne, łącznie z “banalnymi” stetoskopami lekarskimi, czy termometrami można, i “podłącza się” do sieci. Urządzenia przenaszalne (wearables) smartfony, opaski, ringi a nawet e-skarpetki (tak!) służą już do gigantycznego i miejmy nadzieje pożytecznego przetwarzania danych medycznych o milionach ludzi. Sam z takich urządzeń ( nie, nie z e-skarpetek!) już korzystam i potwierdzam, korzyści które mogą choćby z prostego monitorowania podstawowych parametrów zdrowotnych płynąć.

Z drugiej strony, te dosłownie już miliardy medycznych IoT stają się “bramą” do cyber ataków na wielką skalę i, żeby dodać charakterystyczny przykład, mogą służyć do lewarowania ataków DDoS wchodząc w skład botnetu, jak to było w przypadku brytyjskich szpitali z NHS (ichniejszy NFZ) w 2016 i 2017 roku.

Link do Wydawnictwa Uniwersytetu Gdańskiego, gdzie można nabyć książkę:

https://wydawnictwo.ug.edu.pl/ksiegarnia-online/nowosci/ryzyko-nowych-technologii-informacyjnych-w-opiece-zdrowotnej/

Takich ryzyk można mnożyć i wiele z nich znalazło swoje miejsce w mojej książce, ale jak to z analizą ryzyka bywa, konieczny jest też benchmark, jakaś sensowna granica opisu ryzyka, by nie popaść w never -ending identyfikację ryzyka-do-ryzyka-do-ryzyka i nie zawędrować do poziomu na przykład listy 10 000 ryzyk, jak to się wydarzyło w pewnym dużym podmiocie sektora publicznego przy wdrażaniu poronionego pomysłu “Kontroli zarządczej”. Bo tego nie da się ani analizować, ani takim ryzykami docelowo zarządzać, a o to przecież chodzi, w końcu.

Przy okazji, to wspomniana Kontrola Zarządcza jest ciekawym tematem, bo istotą tego projektu zmiany w polskim sektorze finansów publicznych (Ustawa o finansach publicznych z 2009 roku) miało być właśnie “zarządzanie ryzykiem”.

Dość wspomnieć że wiele szpitali i podmiotów opieki zdrowotnej weszło pośrednio bądź bezpośrednio w zasięg “rażenia” tej ambitnej, acz nieprzemyślanej regulacji. Pożytku z niej chyba żadnego jednak nie ma, bo także o identyfikacji ryzyka w opiece zdrowotnej niewiele słychać, w tym z zakresie błędów medycznych czy zdarzeń medycznych także. Lecz książka, ta akturat nie o tym jest…

(Zaś zainteresowanym prawdziwą skalą błędów medycznych (medical malpractice, error) w Polsce polecam przy okazji mój artykuł w współautorstwie, w wolnym dostępie, napiszę o nim tutaj, na Substacku niedługo jeszcze. wnioski z analizy zawartej w artykule są szokujące, ostrzegam)

Z punktu widzenia opisywanych w książce ryzyk i problemu zdarzeń/błędów medycznych (nie pytajcie dlaczego “/” typologia to jeden wielki chaos), to tu jest przysłowiowy “pies pogrzebany”. Bo ryzyka w opiece zdrowotnej niosą “potencjalnie”, wyjątkowe następstwa, nieporównywalne do wielu innych ryzyk, na przykład czysto biznesowych (o których w książce także mowa), a mianowicie związane z najważniejszym podmiotem opieki zdrowotnej: którym jest Pacjent.

Stąd urealnienie się, wydarzenie technologicznych ryzyk “medycznych” może prawie w każdym przypadku mieć wpływ na zdrowie pacjenta, zakłócić proces leczenia, w wielu przypadkach spowodować mniejszy lub większy uszczerbek na zdrowiu.

A w sytuacjach skrajnych także doprowadzić do śmierć pacjenta i to nie tylko z powodu błędnego funkcjonowania na przykład robota medycznego, ale na przykład w efekcie błędnie działającego algorytmu chatbota rozpoznającego mowę pacjenta. Albo udzielającego mu porady zdrowotnej. Albo, albo, albo…

O Czatach LLM, jak GPT, z których już masowo korzystają pacjenci, bez żadnej kontroli i regulacji, nie wspomnę.

Jak wynika z analizy dokonanej w książce ryzyk, które ta “cudowna” technologia (jak zdaje się chcą ją natrętnie reklamować jej twórcy) powinna być dobrze rozpoznana i obiektywnie oceniania. Tak abyśmy się nie obudzili, co niestety już się z rozpędu dzieje, w miejscu, które nam się wcale nie spodoba.

Tu dodam, że wyśmiewanego (niesłusznie moim zdaniem) “buntu maszyn” zasadniczo w książce nie analizuję, ale bynajmniej, wcale nie potrzeba do niego 3PO czy jakiś giga e-mózgów Superinteligencji, wystarczą ‘zwykłe” algorytmy, to również zapewne się wkrótce, albo za jakiś czas okaże. Kto jeszcze pare lat temu, no może oprócz Lema w którego e-mózg Adwokatora Beczkowego wkradł się kompleks podświadomy, w ogóle takie zagrożenia przewidywał.

Na koniec tego krótkiego podsumowania i zachęty dla przyszłego Czytelnika dodam że hipoteza badawcza książki, w końcu naukowej, wcale nie zakładała, mówiąc popularnie, “dowalenia” medycznej algorytmom i związanych z nią technologiami wdrażanymi w opiece zdrowotnej. Wręcz przeciwnie, argumentujemy że wrzucanie, jak to aktualnie zrobił unijny “AI Act” wszystkich algorytmicznych technologii w medycynie do jednego wora “wysokiego ryzyka” a priori, bez analizy, oceny jest bez sensu i przeciwskuteczne.

Bo nie wszystkie ryzyka są tak samo duże, nie dla wszystkich przyczyny-skutki takie same, nie każde zasługuje na taką samą uwagę, każde wymaga innych sposobów, jak to mówi norma ISO 31 000 “postępowania z ryzykiem” (risk treatment).

Bo każda technologia jest dla ludzi. Cokolwiek by to miało w ostatecznym rozrachunku znaczyć…

Jeśli podoba Ci się to co robię na Ryzykonomi, wesprzyj mnie i kup symboliczną kawę na portlu BuyCofee. Link: https://buycoffee.to/ryzykonomia